一、基础网络

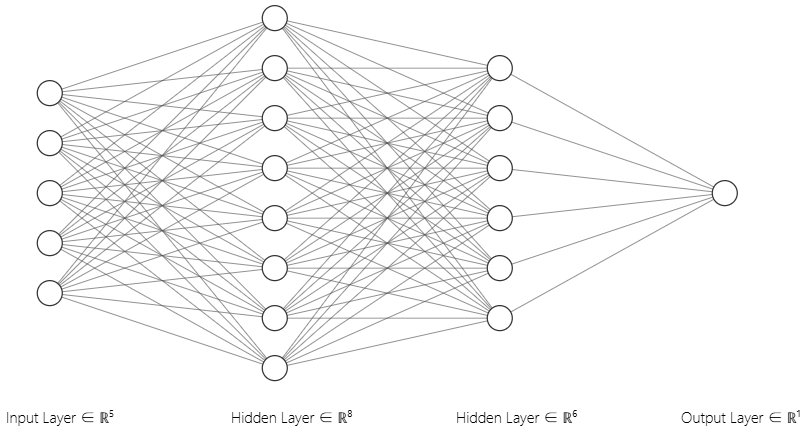

1.FNN(前馈神经网络)

- 思想:全连接层单向传递信号,通过线性变换 + 激活函数拟合非线性关系

- 缺点:无法捕捉时序、空间依赖,仅能处理独立向量数据

- 地位:深度学习最基础模型,所有网络的基础组成单元

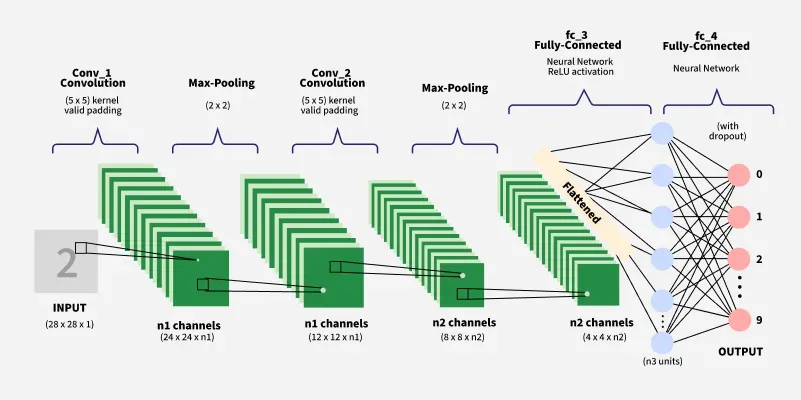

2.CNN(卷积神经网络)

- 思想:卷积核滑动提取局部特征,权值共享降参,适配规则网格空间数据

- 缺点:只能处理欧几里得规则结构,无法建模图拓扑,无原生时序能力

- 地位:规则空间特征提取核心,是 TCN、时空卷积模型的基础

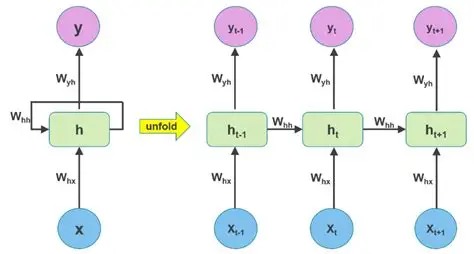

3.RNN(循环神经网络)

- 思想:按时间步一步步递推,用上一时刻隐状态影响当前时刻

- 缺点:长序列会梯度消失 / 爆炸,几乎不直接用在现代时空预测

- 地位:时序模型鼻祖,理解后续时序模型的基础

4.LSTM(长短期记忆网络)

- 思想:在 RNN 基础上加遗忘、输入、输出门,控制信息流动,捕捉长期时序依赖

- 缺点:串行计算无法并行,参数量大、训练速度慢

- 地位:解决长时序依赖的经典模型,时空预测常用时序编码器

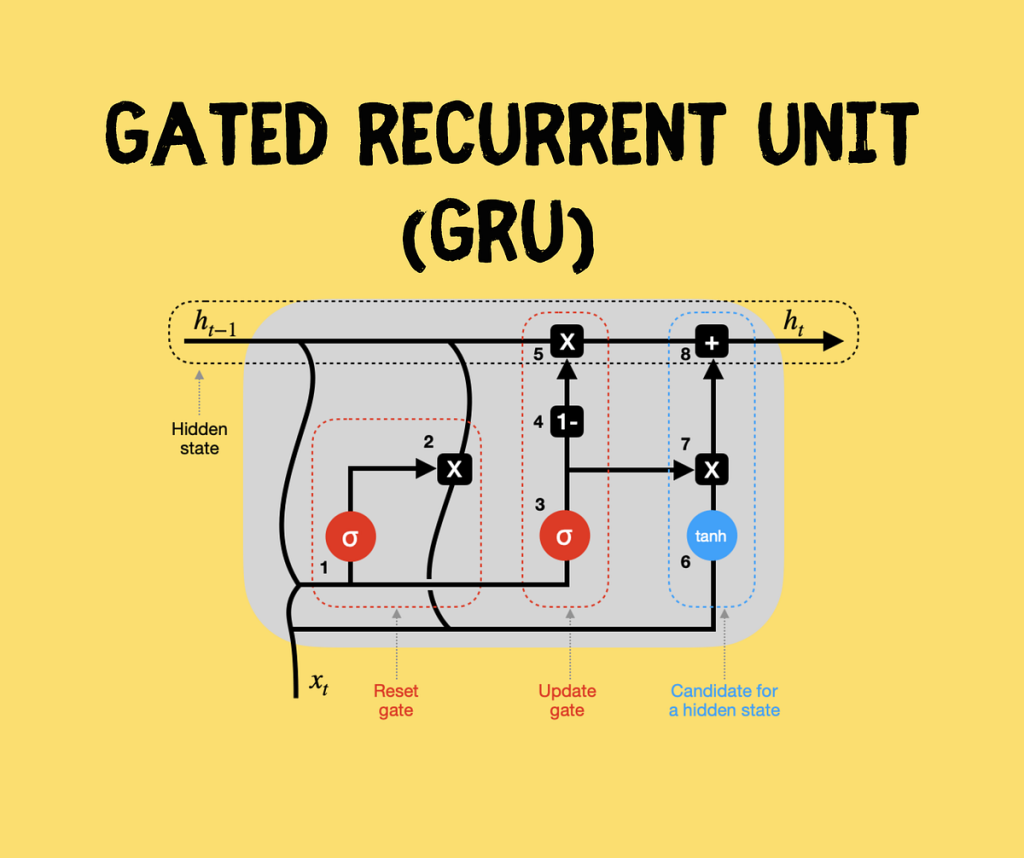

5.GRU(门控循环单元)

- 思想:LSTM 的轻量化版本,合并为更新门、重置门,简化结构保留长时序能力

- 缺点:依旧串行计算,无法并行,长序列效率偏低

- 地位:入门与工业界首选时序模型,平衡效果与效率

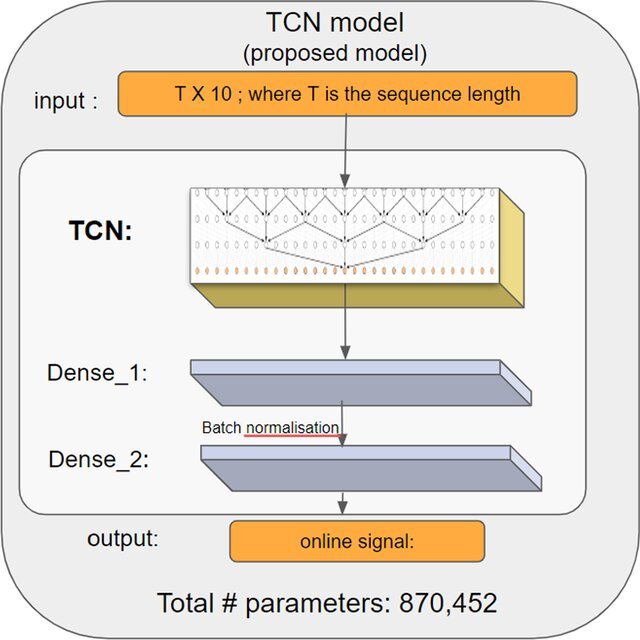

6.TCN(时序卷积网络)

- 思想:用因果卷积 + 空洞卷积建模时序,支持并行,捕捉多尺度时序依赖

- 缺点:对极长序列的全局依赖捕捉能力弱于 Transformer

- 地位:替代 RNN 的高效时序模型,时空预测主流时序卷积方案

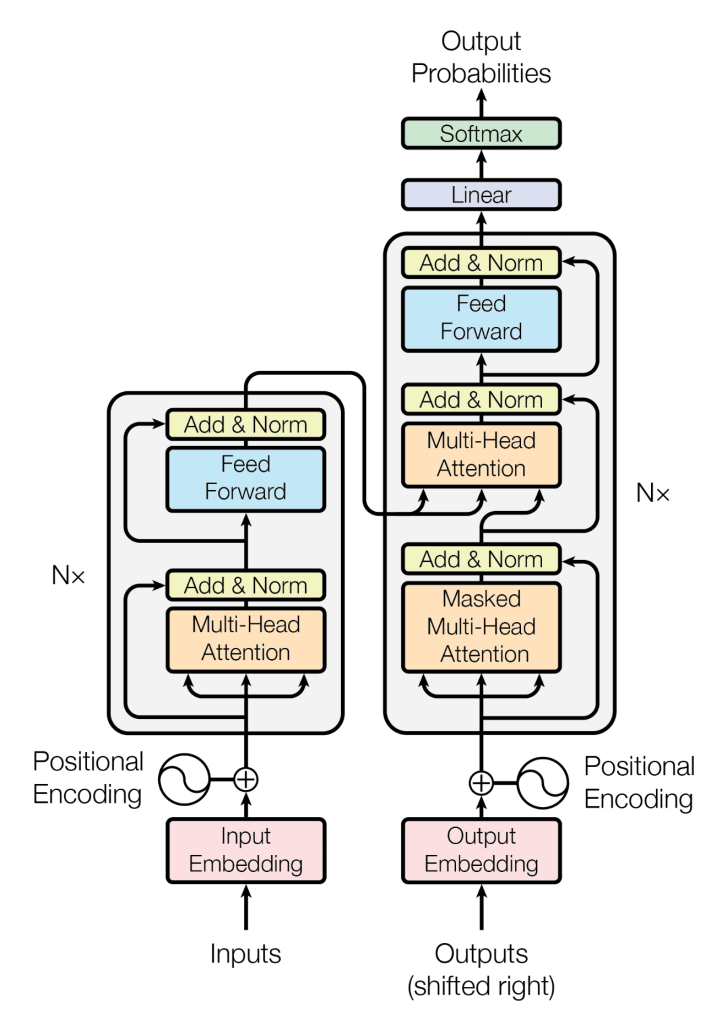

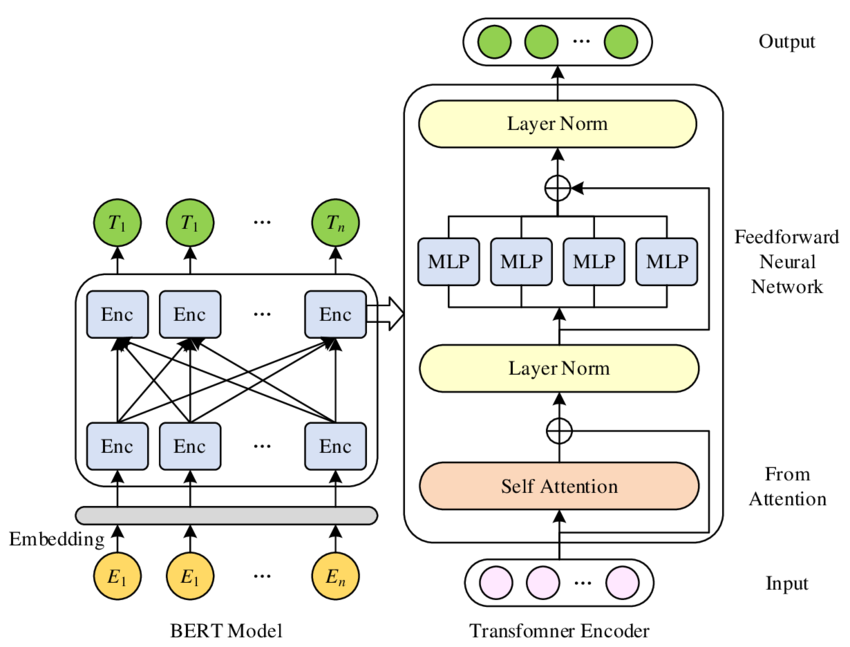

7.Transformer

- 思想:基于自注意力机制,直接捕捉全局依赖,全结构可并行计算

- 缺点:参数量大、计算复杂度高,小数据集容易过拟合

- 地位:当前时序 / 时空预测主流架构,各类时空 Transformer的基础

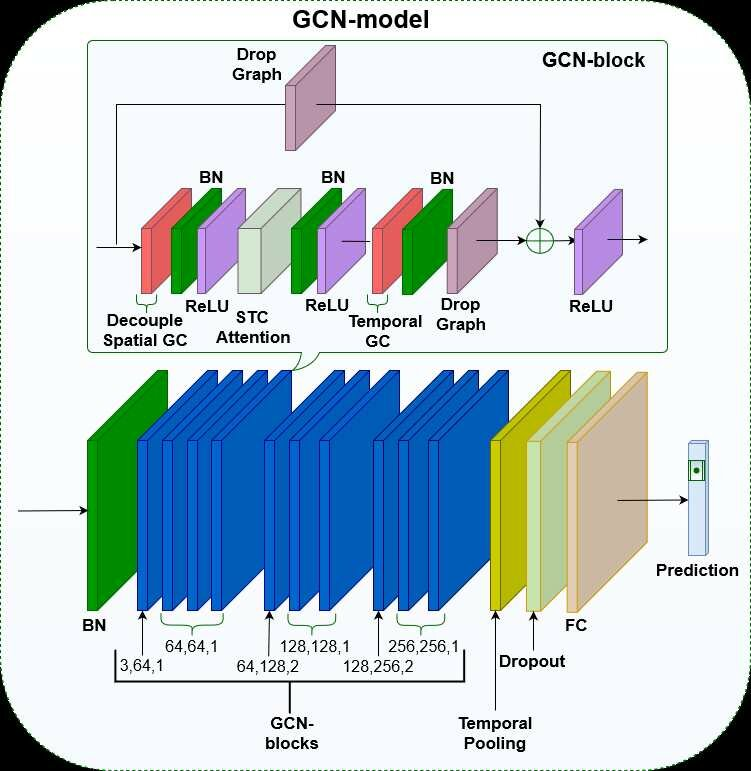

8.GCN(图卷积网络)

- 思想:在图上聚合自身与邻居节点特征,建模非欧几里得空间拓扑依赖

- 缺点:只能建模静态空间关系,邻居权重固定,无法自适应

- 地位:非欧空间建模基石,所有时空图预测模型的核心空间组件

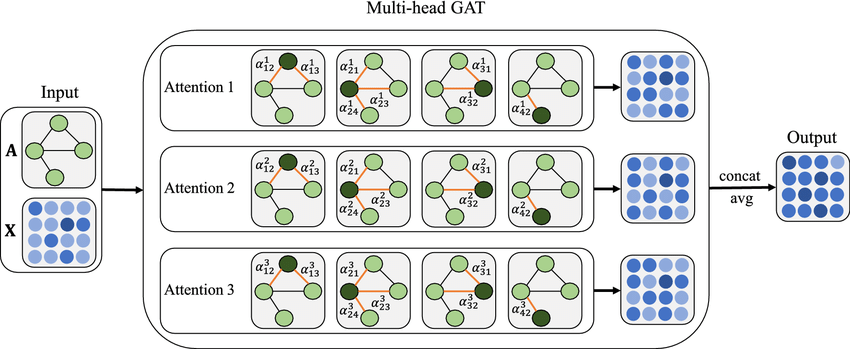

9.GAT(图注意力网络)

- 思想:在 GCN 基础上加入空间注意力,为不同邻居分配自适应权重

- 缺点:计算量比 GCN 高,在超大图上效率较低

- 地位:自适应空间建模主流方案,更贴合真实动态空间关联场景

10.LLM(大语言模型)

- 思想:基于 Transformer 架构,通过海量文本无监督预训练,学习语言规律、知识与语义表示,可适配各类下游任务

- 缺点:参数量巨大、推理耗时高,纯文本建模,对结构化时空数据(图、时序)无原生归纳偏置

- 地位:通用强语义理解基座,可与时空模型融合做知识增强、多模态时空预测

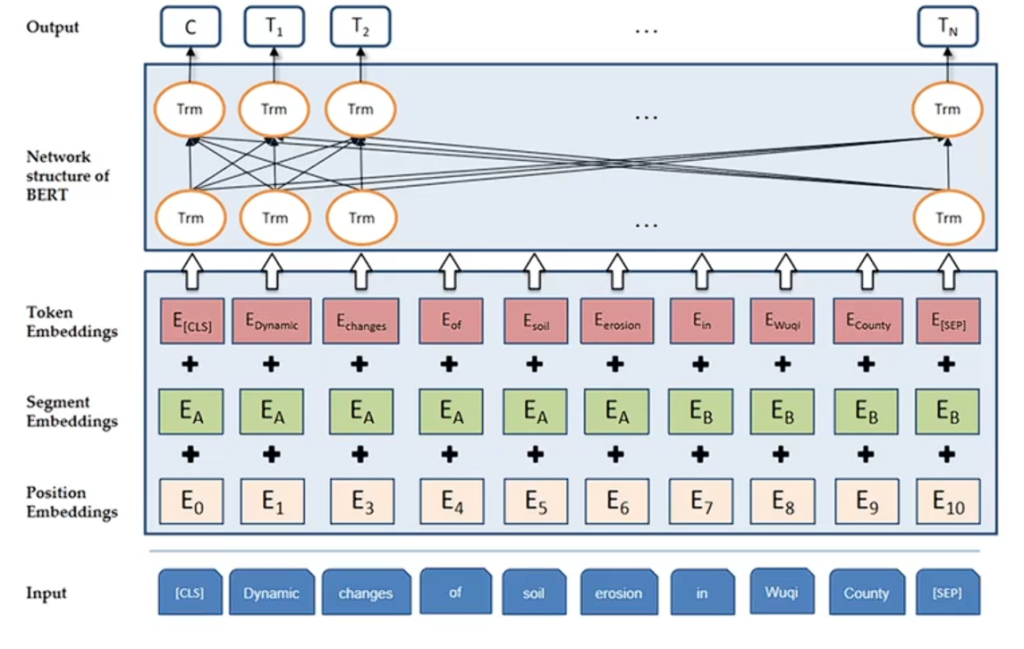

11.BERT(基于 Transformer 的双向编码器表征)

- 思想:采用 Transformer 编码器,通过掩码语言模型 (MLM) 预训练,实现双向上下文语义理解

- 缺点:仅专注文本语义,无时空、图结构建模能力,无法直接处理时空数据

- 地位:NLP 预训练模型里程碑,为各类语义理解任务提供基础,启发时空预训练思路

二、模型设计

1.理解数据特征

不同基础网络能够适配不同数据结构的特征。数据在实际场景中常呈现出向量、时序、网格、拓扑图等多样形态,而多层感知机、循环神经网络、卷积神经网络、图神经网络等经典基础模型,分别在对应类型数据的特征提取上具备专属优势。理解数据特征,就是精准把握数据的内在分布、关联规律、噪声特性与表征维度,从而为模型选择最适配的基础结构,确保模型能够高效、完整地捕捉数据中的有效信息,从源头保障后续特征学习与任务建模的有效性。

2.组合架构能力

复杂网络往往是基础网络的组合,架构组合能力是模型设计的核心体现。单一基础网络仅能适配单一类型数据特征,难以满足实际任务中多尺度、多维度、多模态的复杂建模需求。通过串联、并联、注意力融合等合理方式,将不同基础网络的优势互补整合,可构建出兼顾局部特征、时序依赖、空间关联等多重能力的混合架构。架构组合并非简单的模块堆叠,而是结合任务目标与数据特性的系统性设计,直接决定模型的表达能力、泛化性能与计算效率,是体现建模思路与创新水平的关键。

三、训练和优化

1.训练技巧

基础网络的学习可以帮助我掌握常见的训练技巧。基础网络作为模型设计的基础单元,其训练过程涵盖了数据预处理、梯度优化、过拟合抑制等核心环节。在学习和训练基础网络的过程中,我能够逐步掌握数据增强、批次归一化、梯度裁剪、早停策略等常用训练技巧,了解每种技巧的适用场景与操作逻辑 —— 比如通过基础网络的训练,明确数据增强如何提升模型泛化能力,梯度裁剪如何解决梯度爆炸问题,这些积累的技巧的经验,能够为后续复杂网络的训练提供坚实支撑,帮助我更高效地应对训练过程中出现的各类问题。

2.超参数调整

基础网络的训练过程可以帮助我积累超参数调整的经验。超参数调整没有固定的通用标准,而基础网络的训练的过程,正是探索超参数与模型效果之间关联的最佳实践。在训练基础网络时,我需要反复调试学习率、批次大小、训练轮数、正则化系数、Dropout 率等关键超参数,直观感受不同超参数组合对模型收敛速度、拟合效果的影响 —— 比如调整学习率观察模型是否能稳定收敛,调整批次大小平衡训练效率与泛化能力。这种在基础网络训练中积累的调参经验,能够帮助我建立对超参数的敏感度,掌握 “结合数据特点与任务目标调整超参数” 的思路,为后续复杂网络的超参数优化提供宝贵参考,减少盲目试错,提升调参效率。

三、性能评估和调试

1.性能基准

将基础网络作为性能基准,评估复杂网络的改进效果。以经典基础模型的实验结果作为参照标准,可在相同数据集、训练策略与评价指标下,量化对比复杂网络在精度、收敛速度、鲁棒性等方面的提升幅度,清晰验证结构改进、特征融合、训练策略优化等创新点的有效性,为模型的优越性提供客观、可信的实验依据。

2.调试与优化

理解基础网络的结构和工作原理,帮助我更快地定位和解决复杂网络中的问题。基础网络逻辑简洁、模块单一,便于掌握梯度传播、特征提取、过拟合产生等核心机制;当复杂网络出现不收敛、梯度消失、性能异常等问题时,可借助基础网络的调试经验,快速追溯问题根源,精准完成优化与修复,大幅提升模型开发与调试的效率。

四、创新和改进

1.启发式创新

对基础网络的深入理解可以激发新的想法和创新。基础网络承载了深度学习的经典设计思想与核心机理,只有吃透其优势、局限与适用边界,才能跳出简单套用的误区,从原理层面获得启发。结合具体任务的痛点,对基础结构进行改进、融合与重构,让创新有据可依、有迹可循,为模型设计提供清晰的思路与坚实的理论支撑。

2.定制化解决方案

对基础网络的深入理解可以帮助我根据任务需求灵活调整和优化网络结构。不同任务在数据类型、计算资源、性能要求上存在显著差异,掌握基础网络的设计逻辑与运行机理,便能针对性地进行模块替换、结构精简、特征融合等调整,构建出更贴合任务场景的定制化模型,在精度、效率、实用性之间达到最优平衡。